Distribuição uniforme

Em estatística e probabilidade, a distribuição uniforme é a distribuição de probabilidades contínua mais simples de conceituar: a probabilidade de se gerar qualquer ponto em um intervalo contido no espaço amostral é proporcional ao tamanho do intervalo, visto que na distribuição uniforme a f(x) é igual para qualquer valor de x no intervalo considerado. Por exemplo, se considerarmos um intervalo em x de zero à dez positivo (xЄ[0,10] ), e assumirmos que temos uma distribuição uniforme nesse intervalo, a probabilidade de f(x) no intervalo 2<x<5 é igual a probabilidade de f(x) no intervalo 5<x<8 pois sabemos que a distribuição é uniforme nesses intervalos e possuímos os intervalos com o mesmo tamanho.

Outra maneira de se dizer "distribuição uniforme" seria "um número finito de resultados com chances iguais de acontecer".

Ela é usada quando assumimos intervalos iguais da variável que a mesma probabilidade .

Um simples exemplo de distribuição uniforme é lançar um dado não viciado. Os possíveis valores são 1,2,3,4,5,6, e a cada turno que o dado é jogado a probabilidade de cada valor é 1/6. Se dois dados são lançados e seus valores adicionados, a distribuição resultante não é mais uniforme pois as somas não são uma variável equiprovável.

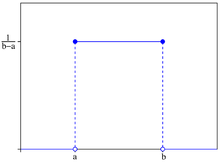

A distribuição discreta uniforme em si não possui parâmetros. No entanto, é conveniente representar seus possíveis resultados com um intervalo fechado [a,b], sendo 'a' e 'b' considerados os principais parâmetros da distribuição. Com isso a função acumulada dessa distribuição é representada como:

Seja [a,b] o espaço amostral. Então temos que a função densidade de probabilidade é:

| Em linguagem matemática | Em Português |

|---|---|

| [1] | A probabilidade de a variável aleatória X ocorrer no intervalo infinitesimal [x*, x*+dx] é se x estiver entre a e b, e zero em caso contrário. |

Esta distribuição tem valor médio ou esperança matemática de X, dada por e variância .

Exemplo básico:

1)Um ponto é escolhido ao acaso no segmento de reta [0, 2]. Qual será a probabilidade de que o ponto escolhido esteja entre 1 e 3/2 ?

F(x) = ½, x ∈ [ 0,2 ]

0, x ∉ [ 0,2 ]

P(1 ≤ x ≤ 3/2 ) = [(3/2) -1] / (2-0)= (1/2)/2= 0.25[2]

Esperança e Variância: origem das fórmulas

A seguir, apresenta-se o desenvolvimento dos cálculos visando chegar as fórmulas anteriormente apresentadas, da esperança e por conseguinte da variância.

Seja X a variável com distribuição uniforme contínua no intervalo de “a” até “b”. Então:

, caso contrário.

Aplicando a fórmula da esperança:

Fatorando:

Calculando a média de X²:

Fatorando:

A fórmula da variância para a distribuição uniforme é a diferença entre a esperança de o quadrado da esperança de . Então:

Tirando o mínimo múltiplo comum:

que nos dá a fórmula:

Exemplos básicos

1) Considere uma experiência aleatória associada a 5 acontecimentos elementares ωi (i = 1, 2, 3, 4, 5) com as seguintes probabilidades:

i 1 2 3 4 5

ωi 0 1 2 3 4

P(ωi) 0.1 0.2 0.3 0.3 0.1

Considere a variável aleatória, definida à custa dos acontecimentos elementares,

2ωi , ωi ≥ 2

X(ωi) =

6ωi −8 , ωi < 2

Determine o valor esperado de X e a probabilidade de X assumir um valor negativo.

Solução:

E (X )= 2.6; P (X < 0)= 0.3

Propriedades da Distribuição Uniforme

As principais medidas para a distribuição uniforme podem ser determinadas de uma forma geral em termos dos extremos "a" e o "b" do intervalo.[3]

Média, expectância ou valor esperado

Desvio Padrão

A FDA da distribuição Uniforme

A FDA da distribuição uniforme, pode ser facilmente avaliada e, vale:

Exemplo:

Seja X uma VAC com distribuição uniforme no intervalo [5, 10]. Determinar as probabilidades:

a) P(X < 7)

b) P(X > 8,5)

c) P(8 < x < 9)

Soluções:

Utilizando a FDA da variável vem:

a)

b)

c)

Estimativa do máximo

Ver artigo principal: Problema dos tanques alemães

Ver artigo principal: Problema dos tanques alemãesEsse exemplo é descrito com uma amostra de k observações obtidas de uma distribuição uniforme no inteiros , com o problema de se estimar o N máximo. Esse problema é comumente como o Problema dos tanques alemães.

O estimador de variancia mínima não-enviesada para o máximo é dado por

onde m é o maior valor da amostragem e k é o tamanho da amostra, sendo a amostragem sem reposição.

A fórmula pode ser entendida como:

- "O valor máximo da amostra mais a média intervalar entre as observações na amostra".

Isto possui variância de

Aplicações

Geral

No geral o uso de distribuição uniforme é utilizado para se ter o número das chances possíveis de um determinado evento ocorrer, dentro de um limite de duas variáveis logicas. Como por exemplo a probabilidade de peças com defeitos em um lote com determinada quantidade de peças.

Informática

A maioria das linguagens de programação, pacotes estatísticos ou planilhas de cálculo possuem um gerador de números aleatórios, que gera a partir de uma distribuição uniforme, com valores entre 0 e 1. Esse número é chamado de pseudo-aleatório, porque é possível repetir a mesma sequência a partir de uma mesma semente (valor inteiro).

Simulação de outras distribuições

Qualquer outra distribuição contínua, na qual a função distribuição acumulada seja invertível, pode ser simulada a partir da distribuição uniforme.

Seja U a distribuição uniforme com valores no intervalo [0,1], e X uma variável aleatória contínua com distribuição acumulada F(x). Então:

Para demonstrar, devemos provar que a chance de simular um valor de X entre a e b por esse método é igual à probabilidade da variável aleatória X gerar um valor entre a e b.

Por um lado, a chance de é igual à chance de (pela monotonicidade de F), e, como , essa chance é igual a F(b)-F(a).

Por outro lado, a chance de X gerar um valor entre a e b, é a chance de X gerar um valor menor ou igual a b menos a chance de X gerar um valor menor ou igual a a (onde usamos o fato de X ser contínua, ou seja, a probabilidade um ponto é zero). Usando a definição de distribuição acumulada, essa chance é F(b)-F(a).

Erro de quantização

Numa conversão de valores analógicos para valores digitais, pode´se existir um erro baseado no arredondamento ou truncamento. Quando o erro é muito maior que um BIt menos significativo, o erro de quantização tem uma distribuição praticamente uniforme.

Veja também

- Função exponencial

- Delta de Dirac

Referências

- ↑ WALPOLE, Ronald E.; MYERS, Raymond H.; MYERS, Sharon L. e YE, Keying. Probability & Statistics for Engineers & Scientists. Pearson Education International. ISBN 0132047675. Página 172.

- ↑ Referência: LIBERAL, Prof. Tarciana. Probabilidade II. Paraíba: Universidade Federal da Paraíba, [20--]. Color.

- ↑ VIARI, Lori. Probabilidade. Rio Grande do Sul: PUCRS

Ligações externas

- «Calculadora - Distribuição uniforme»

| Este artigo sobre matemática é um esboço. Você pode ajudar a Wikipédia expandindo-o. |

Portal de probabilidade e estatística

Portal de probabilidade e estatística

![{\displaystyle F^{-1}(U)\in \left[a,b\right]\,}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7d1685e5a0d5300b93585fc45e930b35ed3fbd93)

![{\displaystyle U\in \left[F(a),F(b)\right]\,}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6ce8ea18f48ab7fa91022c7d2721c6ecf42472e3)